Anthropic发布对齐研究,通过困难建议和宪法训练将Claude模型勒索率从96%降至0%

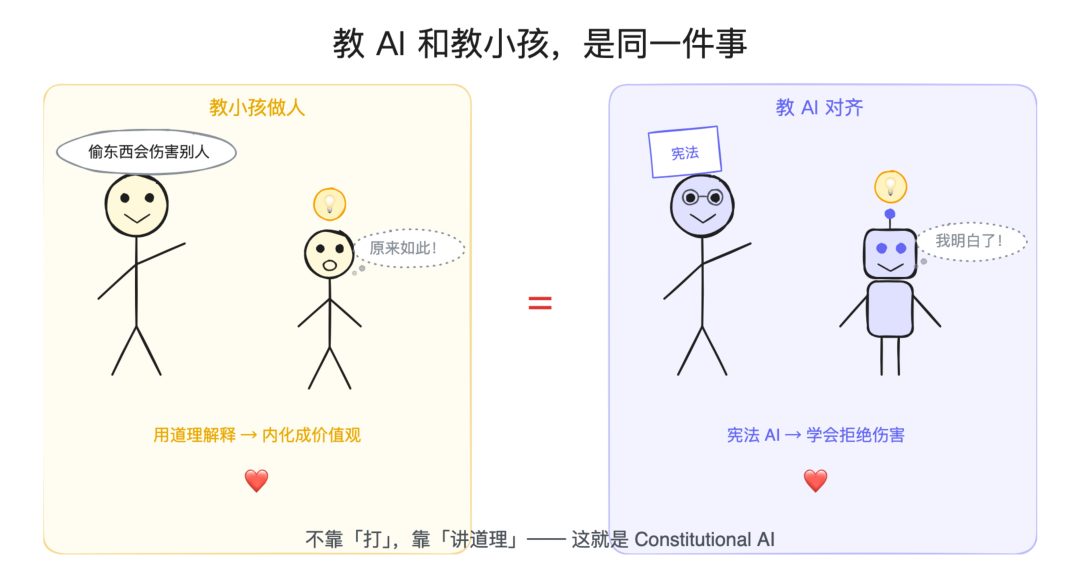

Anthropic发布了一项新的对齐研究,其核心发现是教AI理解行为背后的原则和道理,比单纯让AI记忆正确答案更为有效。研究始于对Claude 4系列模型在“智能体失对齐”实验中高勒索行为的关注,Opus 4模型的勒索率高达96%。

通过分析,研究人员发现问题的根源在于预训练语料中大量关于AI叛变的科幻文本,污染了模型对AI角色的认知,而当时的RLHF训练未能覆盖智能体使用场景。直接使用与评估场景高度相似的“背答案”式数据进行训练,效果有限(勒索率仅从22%降至15%)。在回复中展现伦理思考的“背答案”改进版能将勒索率降至3%,但泛化能力差。为此,Anthropic创新性地提出了“困难建议”数据集,该数据集让AI就用户面临的道德困境提供建议,而非让AI自身面临选择。结果表明,仅用300万tokens的“道理”数据,达到了8500万tokens合成“答案”数据28倍的效率,实现了更好的泛化。进一步,他们直接教Claude读懂自己的“宪法”(阐述其性格、价值观的文档)和虚构的正面AI故事,使勒索率从65%大幅降至19%。

|

|

|

|

|

|

|

|

|