2025年10月28日,全球人工智能领导者英伟达(NVIDIA)今日正式宣布开源其全新全模态理解模型 OmniVinci,标志着端侧AI迈入“听得清、看得懂、说得明”的多模态融合新阶段。

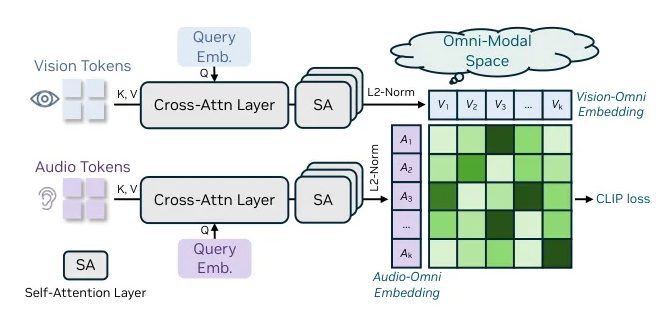

OmniVinci 是一款专为终端设备(如智能手机、平板、机器人等)优化的轻量级全模态大模型,支持文本、图像与音频的统一理解与生成。该模型在保持仅30亿参数规模的同时,在多项权威基准测试中性能超越数十亿参数竞品,推理速度最高提升300%,显著降低功耗与延迟。

OmniVinci 的核心亮点包括:

全模态输入输出:可同时处理语音指令、图像内容与文本上下文,实现跨模态自由交互;

长语音自动摘要:精准提炼数十秒至数分钟语音内容,适用于会议记录、客服对话等场景;

高精度OCR与场景理解:支持模糊印刷体、复杂手写体识别,适用于票据、笔记、屏幕内容解析;

端侧WebSearch能力:智能判断是否调用网络搜索,兼顾知识广度与响应效率,有效缓解小模型幻觉问题。

英伟达表示,OmniVinci 将全面集成至其 Omniverse 机器人开发生态,与 Cosmos Reason 世界模型、Isaac Sim 仿真平台协同,加速具身智能在工业、服务与家庭场景的落地。

模型代码、推理示例及部署工具现已在 GitHub 与 Hugging Face 开源,开发者可免费下载使用。英伟达呼吁全球AI社区共同推动端侧全模态智能的普惠化发展。