谷歌发布TurboQuant算法 实现大模型内存压缩六倍

谷歌研究院正式发布向量量化压缩算法TurboQuant,宣称可在不损失模型推理准确率的前提下,将大语言模型运行时关键的键值缓存(KV Cache)内存占用压缩至原有水平的1/6,同时显著提升运行性能,为AI大模型轻量化部署带来重要突破。

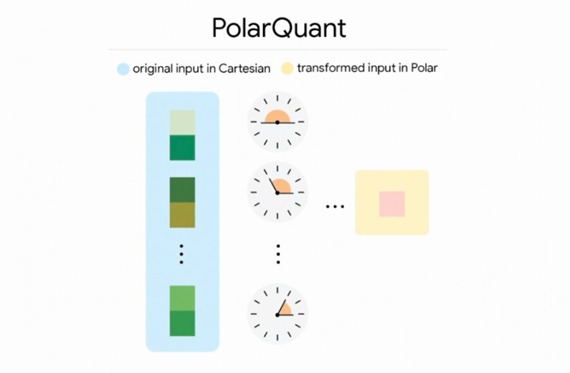

据悉,TurboQuant采用双阶段压缩架构,通过PolarQuant极坐标量化与QJL 1比特误差校正技术的创新结合,解决了传统量化方法需额外存储量化参数、易损失精度的痛点。其中,PolarQuant将数据从笛卡尔坐标转换为极坐标,简化存储并消除额外开销;QJL技术则通过1比特符号校正压缩残差,确保推理精度无损,整个过程无需对现有模型进行重新训练或微调即可直接应用。

实测数据显示,该算法在Gemma、Mistral等开源模型测试中,可将KV缓存量化至3比特,内存占用降幅达83%;在英伟达H100 GPU上,4比特配置下的注意力计算速度较32位未量化模型提升高达8倍,在长文本问答、代码生成等任务中表现与未压缩模型完全一致。此外,该算法在向量搜索场景中也表现突出,召回率优于传统量化方法,且无需离线构建码本,适配在线索引场景需求。

TurboQuant的发布引发市场强烈反应,消息公布后首个美股交易日,闪迪、美光科技等全球内存巨头股价集体下跌,全球主要内存企业市值合计蒸发超900亿美元(约合人民币6200亿元),市场担忧该技术会减少AI领域的内存需求。不过机构观点存在分化,摩根士丹利等分析指出,该技术仅优化推理阶段的KV缓存,不影响模型训练环节的内存需求,且效率提升可能降低AI部署门槛,反而刺激整体需求增长,类似此前DeepSeek技术发布后算力需求反而攀升的逻辑。

|

|

|

|

|

|

|

|

|