谷歌Search Live全球正式上线,重塑AI实时搜索新体验

当地时间2026年3月26日,科技巨头谷歌正式宣布,其由人工智能驱动的对话式搜索功能Search Live已在全球范围内全面上线,覆盖200多个国家和地区,将为所有已支持“AI模式”的语言与地区用户提供服务,标志着传统搜索向多模态实时交互的重大跨越。此前,该功能仅在美国、印度等少数市场进行试点,此次全球扩容完成了从测试到普及的关键一步。

Search Live最早于2025年7月首次推出,核心亮点在于打破传统文字输入搜索的局限,实现“视觉+语音+对话”的多模态交互——用户可通过手机摄像头对准现实中的物体、场景,结合语音提问,与搜索系统进行基于画面内容的自然来回对话,让搜索从“被动查询”转变为“主动辅助”的即时交互体验。这种交互方式尤其适用于“打字不够好用”的场景,解决了用户双手忙碌、无法手动输入关键词的痛点。

此次全球扩展的背后,离不开谷歌新一代音频与语音模型Gemini 3.1 Flash Live的技术支撑。该模型主打“自然直觉化人机对话”,具备原生多语言支持能力,无需外挂翻译层,能流畅应对200多种语言的交互需求,甚至可精准识别方言与混合语言提问,大幅降低了不同地区用户的使用门槛,尤其适配印度、印尼等以手机为主要终端、语音为主要输入方式的增长市场。

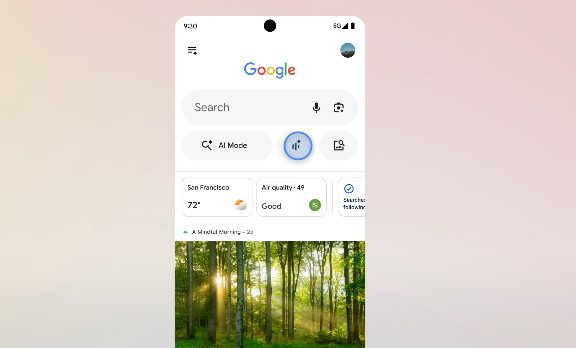

从使用方式来看,Search Live操作便捷且无缝融入谷歌生态。用户只需在Android或iOS设备上打开谷歌应用,点击搜索框下方的“Live”图标即可启用;若已在使用Google Lens对准某个对象进行识别,也可通过点击屏幕底部的“Live”选项,直接切换至实时对话模式。启用后,用户可通过语音直接提问并获得语音回答,同时支持追问式交互,必要时还能点选屏幕显示的网页链接,深入获取更多信息,实现“对话+深度查询”的双重需求。

谷歌在官方说明中列举了多个核心应用场景,全方位覆盖用户生活、学习、出行等需求:旅行时,可双手-free询问目的地周边信息,对准陌生建筑、地标即可获取背景介绍;学习新爱好(如冲泡抹茶)时,可将摄像头对准工具、食材,询问使用方法与食材替代方案;解决设备故障(如组装搁板、连接家庭影院线缆)时,摄像头可提供视觉上下文,搜索系统将给出分步操作建议;辅导孩子完成手工、科学实验时,还能实时解释现象背后的原理并推荐相关拓展资源。早期测试数据显示,67%的Search Live会话包含至少一次追问,远超传统搜索1.2次的平均交互次数,印证了用户对这种对话式搜索的接受度与依赖性。

值得注意的是,此次谷歌同步扩展了相关配套功能——将Google翻译中的“Live Translate”(实时翻译)功能延伸至iOS平台,支持德国、西班牙、日本、泰国等多个国家,结合此前已覆盖的Android平台,目前全球用户可通过任意耳机,以70多种语言访问实时翻译服务,与Search Live形成功能互补,进一步完善多语言交互生态。

Search Live的全球上线,不仅重塑了用户的搜索习惯,也对全球搜索市场格局产生深远影响。与传统文字搜索、静态视觉搜索(如Google Lens)不同,Search Live实现了“动态视觉+实时对话”的融合,填补了“即时行动场景”的搜索空白,区别于Gemini Live(纯对话AI)、ChatGPT语音模式(侧重长文本与创意任务)的定位,形成独特的竞争优势。其核心竞争力在于“场景化即时响应”,无需用户精准输入关键词,只需通过视觉和语音传递需求,即可获得针对性反馈,这也让苹果Siri、亚马逊Alexa等传统语音助手面临更大竞争压力——谷歌通过将搜索本身打造成语音原生产品,绕过了中间载体,进一步巩固了其在搜索领域的领先地位。

业内分析认为,Search Live的普及或将推动搜索行业进入“多模态实时交互”的新阶段。随着全球200多个国家和地区用户的使用,海量语音、视觉交互数据将反向喂养Gemini模型,进一步优化其识别精度与对话流畅度,形成“数据-模型-体验”的正向循环。对于企业而言,这一功能的上线也意味着新的机遇与挑战,未来需优化谷歌商业档案布局,以适配用户通过视觉、语音搜索获取本地服务的新需求。

目前,Search Live已全面开放至所有支持谷歌AI模式的地区,用户可免费体验,无需额外下载应用或参与实验性测试。谷歌表示,将持续收集全球用户的使用反馈,不断优化功能体验,探索更多场景化应用,推动搜索技术向更智能、更贴近用户需求的方向发展,重新定义信息获取的方式与效率。

|

|

|

|

|

|

|

|

|